LLMs como Cartógrafos del Conocimiento: Una Perspectiva Geométrico-Topológica

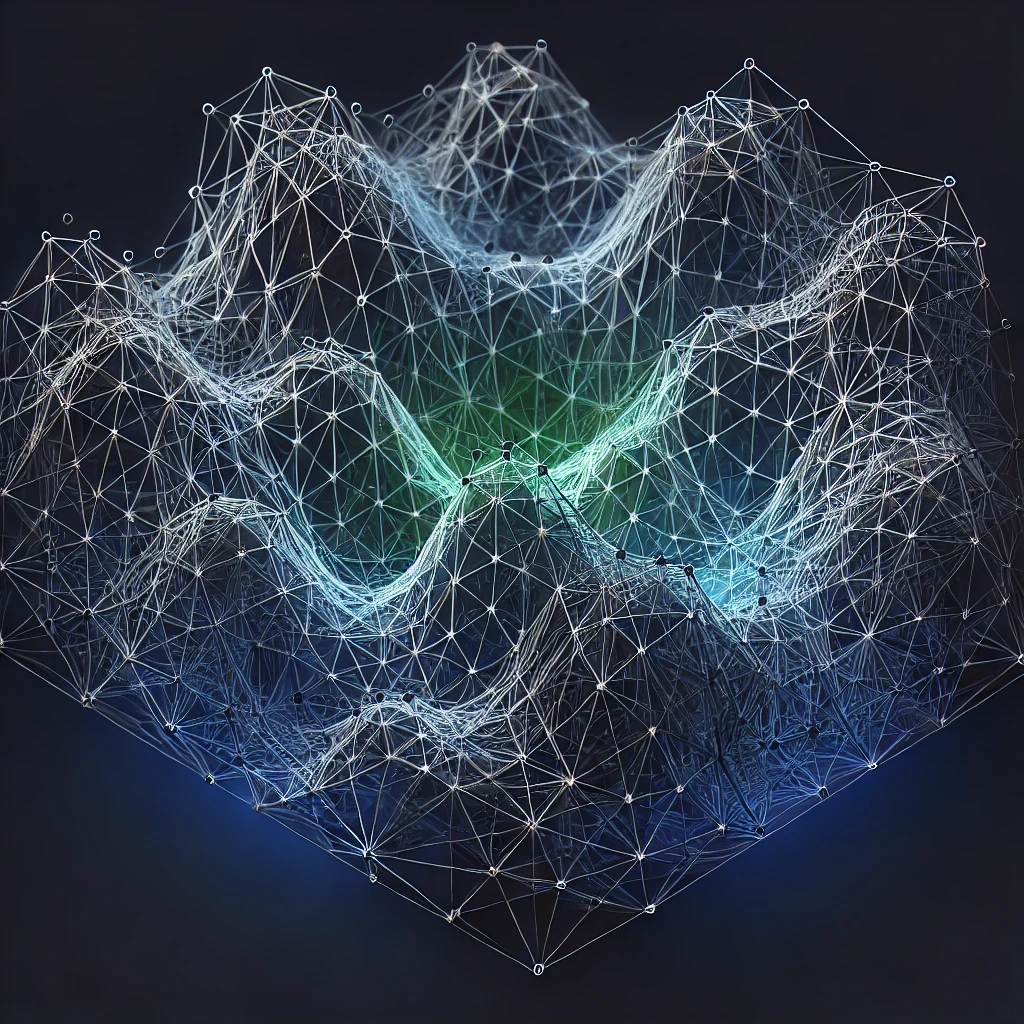

Una propuesta teórico-conceptual que plantea un nuevo marco para entender los LLMs como cartógrafos dinámicos que construyen un mapa interno del conocimiento.

LLMs como Cartógrafos del Conocimiento: Una Perspectiva Geométrico-Topológica para la Interpretabilidad #

Situación / Problema (El Desafío de la Caja Negra): Los Modelos de Lenguaje a Gran Escala (LLMs) como los Transformers son increíblemente potentes, pero a menudo funcionan como "cajas negras". Entender cómo llegan a sus conclusiones, por qué a veces "alucinan" (inventan información) o muestran sesgos es crucial para construir IA más fiable y robusta. Las explicaciones tradicionales no siempre capturan la complejidad de sus "razonamientos" internos.

Mi Propuesta y Objetivo (Investigación Teórico-Conceptual): Este trabajo propone un nuevo marco conceptual: ver a los LLMs como cartógrafos dinámicos. En lugar de solo procesar texto, los LLMs construirían y refinarían continuamente un "mapa interno" del conocimiento. Este mapa es una superficie (o variedad) geométrica en un espacio de alta dimensión, donde las relaciones semánticas, la confianza y los errores tienen correlatos geométricos y topológicos. El objetivo es utilizar herramientas de la geometría diferencial y la topología para:

- Diagnosticar problemas como alucinaciones y sesgos (viéndolos como "accidentes geográficos" en el mapa).

- Proponer mecanismos para regular y mejorar el comportamiento de los LLMs, "reparando" o "suavizando" estas superficies internas.

- Ofrecer una intuición más profunda y accionable sobre el funcionamiento interno de estos modelos.

Tecnologías y Metodología (Con Foco Python/ML/XAI Avanzado):

-

Fundamentos de LLMs y Transformers:

- Embeddings: Vistos como proyecciones de tokens a puntos en un espacio ℝd, formando la base del "mapa".

- Atención Multi-cabeza: Interpretada como un sistema de "espejos" que reconstruyen el contexto desde múltiples perspectivas, definiendo la estructura local del mapa.

-

Formalización Matemática (El "Mapa Interno"):

- Variedad Riemanniana M(t): El "mapa" se modela como una subvariedad que evoluciona con el entrenamiento (t). Su geometría (curvatura, distancias geodésicas) captura las relaciones semánticas.

- La métrica g_ij(t) define cómo se miden distancias localmente.

- Función de Densidad p_M(v,t): Representa la "masa semántica" o confianza del modelo en diferentes regiones del mapa. Zonas de baja densidad se asocian con incertidumbre.

- Analogía con Flujos Geométricos: El proceso de retropropagación (entrenamiento del LLM) se ve como un análogo discreto a flujos geométricos (ej. Flujo de Ricci-Bourguignon) que deforman y refinan la variedad M(t).

- Variedad Riemanniana M(t): El "mapa" se modela como una subvariedad que evoluciona con el entrenamiento (t). Su geometría (curvatura, distancias geodésicas) captura las relaciones semánticas.

-

Herramientas de Análisis (XAI Geométrico):

- Curvatura: Para identificar "deformaciones" (sesgos) o "singularidades" (potenciales fuentes de alucinaciones).

- Distancia Geodésica: Para entender el "viaje semántico" que realiza el LLM al generar texto o razonar. La ventana de contexto limita esta distancia.

- Topología Computacional (ej. Homología Persistente): Para estudiar la estructura global del "mapa", identificar "agujeros" (conceptos faltantes) o conexiones inesperadas.

- Grafos Semánticos: Como una discretización de la variedad, útil para cálculos locales y algoritmos eficientes (ej. curvatura de Ollivier-Ricci).

-

Simulaciones y Aplicaciones Conceptuales (Python):

- Aunque el trabajo es principalmente teórico, se exploran implicaciones para el diseño de LLMs y estrategias de entrenamiento.

- Se piensa en cómo herramientas de Python (ej. librerías de geometría computacional, visualización de datos de alta dimensión, o incluso frameworks de ML para experimentar con regularizadores geométricos) podrían usarse para implementar y testear estas ideas.

Interpretaciones y Aplicaciones Clave (La Geometría de los Problemas de los LLMs):

-

Alucinaciones como "Zonas de Baja Densidad":

- El modelo "inventa" cuando navega por regiones del mapa donde p_M(v,t) ≈ 0 (conocimiento escaso).

- Mitigación propuesta: Incrementar la "temperatura semántica" (concentrar la atención en zonas densas) o reentrenar añadiendo datos en esas "lagunas".

-

Sesgos como "Deformaciones Sistemáticas":

- El mapa se "retuerce" o "colapsa" en ciertas áreas, alterando las distancias semánticas y favoreciendo estereotipos.

- Mitigación propuesta: Reentrenamiento focalizado para "re-expandir" esas zonas o añadir penalizaciones de curvatura en la función de pérdida del LLM.

-

Ventana de Contexto como "Capacidad de Viaje Semántico":

- Una ventana más grande permite "trayectorias geodésicas" más largas y coherentes a través del mapa de conocimiento.

- Esto explica por qué modelos con contextos más amplios son mejores en tareas de razonamiento multi-paso.

-

Navegación y "Cortafuegos Geométricos":

- Se podría dirigir la generación de texto a lo largo de trayectorias específicas en el mapa (navegación temática) o incluso "bloquear" el acceso a regiones problemáticas (cortafuegos).

Impacto y Aprendizajes:

- Nuevo Paradigma para la Interpretabilidad (XAI): Ofrece un lenguaje y un conjunto de herramientas radicalmente nuevas para entender los LLMs, yendo más allá de las explicaciones basadas en características o ejemplos.

- Hacia LLMs más Robustos y Controlables: Las ideas sobre cómo "reparar" el mapa interno abren vías para mitigar activamente alucinaciones y sesgos de forma fundamentada.

- Conexión Interdisciplinar: Une el Machine Learning con campos profundos de las matemáticas (geometría diferencial, topología), abriendo nuevas líneas de investigación.

- Este proyecto es una exploración de cómo la abstracción matemática y el pensamiento geométrico pueden arrojar luz sobre los mecanismos internos de sistemas de IA complejos, un área que me apasiona profundamente.

Palabras Clave: LLMs, Transformers, Interpretabilidad (XAI), Geometría Diferencial, Topología, Variedades Riemannianas, Flujos Geométricos, Embeddings, Alucinaciones, Sesgos, Ventana de Contexto, Python (conceptual).